AI-beheer en -borging: de waarde van ISO/IEC 42001-certificering voor AI-managementsystemen

Dit artikel beschrijft het belang van AI-managementsystemen volgens ISO/IEC 42001. Het benadrukt de noodzaak van veilige, betrouwbare en ethische AI-implementatie en biedt richtlijnen voor certificering en risicobeheer om vertrouwen en transparantie te waarborgen.

Kunstmatige intelligentie (AI) transformeert de wereld en schept nieuwe kansen én uitdagingen voor organisaties en de samenleving als geheel. Sinds de opkomst van generatieve AI, met toepassingen zoals ChatGPT en Copilot, is er een exponentiële groei geweest in het aantal organisaties dat voor het eerst gebruikmaakt van AI en hiermee experimenteert. Succesvolle implementaties laten zien dat AI kan leiden tot efficiëntie, kwaliteit, innovatie en klanttevredenheid. Elke nieuwe technologie brengt echter risico’s met zich mee. AI kent volop potentiële uitdagingen en onzekerheden, die moeten worden beheerst en gemitigeerd om veilige, betrouwbare en ethische ontwikkeling, implementatie en toepassing van AI te waarborgen.

De rol van een AI-managementsysteem (AIMS) op basis van de ISO/IEC 42001-norm is dan ook essentieel voor organisaties die hun AI-traject zorgvuldig willen beheren. Een gestructureerde aanpak dwingt tot ‘eerst denken, dan doen’ en tot voortdurende beoordeling van prestaties en resultaten. Deze fundamentele norm voor AI-management, risicomanagement en certificering door externe partijen wordt al erkend als een essentieel kader om richting te geven aan de ontwikkeling en levering van betrouwbare AI-oplossingen.

In deze whitepaper schetsen we de noodzaak van AI-management en beschrijven we hoe uw organisatie zowel interne als externe vereisten kan ontwikkelen, beheren en naleven om een succesvolle implementatie van AI in processen, producten en diensten te bevorderen.

De behoefte aan veilige en verantwoorde toepassing van AI

De behoefte aan betrouwbare AI wordt versterkt door de toegenomen experimenten met AI, de groeiende adoptie van de vele AI-toepassingen, de toenemende bekendheid en steeds grotere verwachtingen onder stakeholders en de ontwikkelingen op het gebied van ethiek en regelgeving. Het gevolg is dat organisaties de voordelen van AI alleen kunnen realiseren wanneer de vertrouwenskloof tussen ontwikkelaars en gebruikers van AI wordt overbrugd. Met ‘vertrouwenskloof’ bedoelen we het potentiële gebrek aan vertrouwen en transparantie met betrekking tot de AI-gebaseerde producten en/of diensten van een organisatie. Als het voor gebruikers bijvoorbeeld onduidelijk is hoe AI-systemen tot hun beslissingen komen, leidt dit tot onzekerheid en scepsis op het gebied van veiligheid, ethische aspecten, gegevensbescherming en de algemene geloofwaardigheid. Simpel gezegd: het vertrouwen in een technologie is gebaseerd op ons vermogen om het gebruik hiervan volledig te begrijpen en zekerheid te krijgen dat het veilig en betrouwbaar werkt.

Het dichten van deze vertrouwenskloof is cruciaal voor het succesvol op de markt brengen en opschalen van AI-gedreven producten en diensten. Dit vereist dat u zorgt voor veilige, verantwoorde, betrouwbare en ethische implementatie van AI. Bovendien moet u waarborgen bieden aan zowel interne stakeholders (zoals medewerkers en senior management) als externe stakeholders (zoals klanten en aandeelhouders).

Om uw oplossingen betrouwbaar te maken en deze betrouwbaarheid te kunnen aantonen, moet u een systematische aanpak volgen die de gehele AI-levenscyclus bestrijkt, van stakeholderanalyse, het opstellen van ‘vangrails’ (zoals ethische richtlijnen), prioritering van toepassingen en identificatie van risico’s tot en met de implementatie van relevante beheersmechanismen. Wanneer we de vertrouwenskloof van dichterbij bekijken, komen duidelijke behoeften en verwachtingen aan het licht. Uw organisatie moet bijvoorbeeld:

- de gebieden en toepassingen in kaart brengen en prioriteren waar AI waarde kan toevoegen en impact kan hebben, en inzicht krijgen in de voordelen en risico’s;

- een cultuur van vertrouwen, transparantie en verantwoording binnen de organisatie tot stand brengen en onderhouden;

- de prestaties en de kwaliteit van AI-systemen beoordelen en meten, en zorgen voor afstemming op de betrouwbaarheidsprincipes, huidige of toekomstige wetgeving en eisen van klanten;

- rollen en verantwoordelijkheden binnen de organisatie toewijzen, wat extra belangrijk is in een technologisch domein dat zich verder blijft ontwikkelen;

- processen voor ontwikkeling, implementatie en governance van AI implementeren op basis van best practice-normen (zoals ISO/IEC 42001);

- de betrouwbaarheid van AI-systemen communiceren naar stakeholders, en zekerheid en bewijs verschaffen van de naleving van best practices en wet- en regelgeving.

Dit is een algemeen, zij het onvolledig, overzicht van de belangrijkste behoeften en verwachtingen. De ISO/IEC 42001-norm voor AI-managementsystemen is ontworpen om richting en structuur te bieden voor het effectief omgaan met deze behoeften en verwachtingen.

De rol van normalisatie bij AI-governance

Elke nieuwe technologie brengt risico’s met zich mee. Vanwege het enorme potentieel van de toepassing van AI-systemen in verschillende sectoren geldt dit eens te meer voor kunstmatige intelligentie. Het is bijvoorbeeld niet mogelijk om alle denkbare uitkomsten al in de ontwerpfase te voorspellen.

In deze context worden managementsysteemnormen zoals ISO/IEC 42001 extra belangrijk. Wanneer er grote behoefte is aan publiek vertrouwen, spelen normalisatie en certificering een cruciale rol. Naast wettelijke, regelgevende en ethische overwegingen is normalisatie ook een middel om schaalbaarheid mogelijk te maken, veiligheid te verankeren en organisaties te begeleiden naar het onbekende terrein dat AI nu nog is.

Door middel van ISO-normen wordt de belangrijkste terminologie vastgesteld, worden industriestandaarden gestimuleerd en best practices voor beoordeling en verbetering vastgelegd. Normen voor AI-management scheppen duidelijkheid en definiëren verantwoordelijkheid en zullen de maatschappelijke acceptatie ondersteunen. Ze bieden een basis voor naleving van regelgeving en acceptatie door de industrie, ze versnellen het vermogen om het wereldwijde potentieel van AI op een veilige, verantwoorde en ethische manier te benutten en ze zorgen voor transparantie, veiligheid en vertrouwen bij gebruikers en andere stakeholders.

De rol van AI-managementsystemen

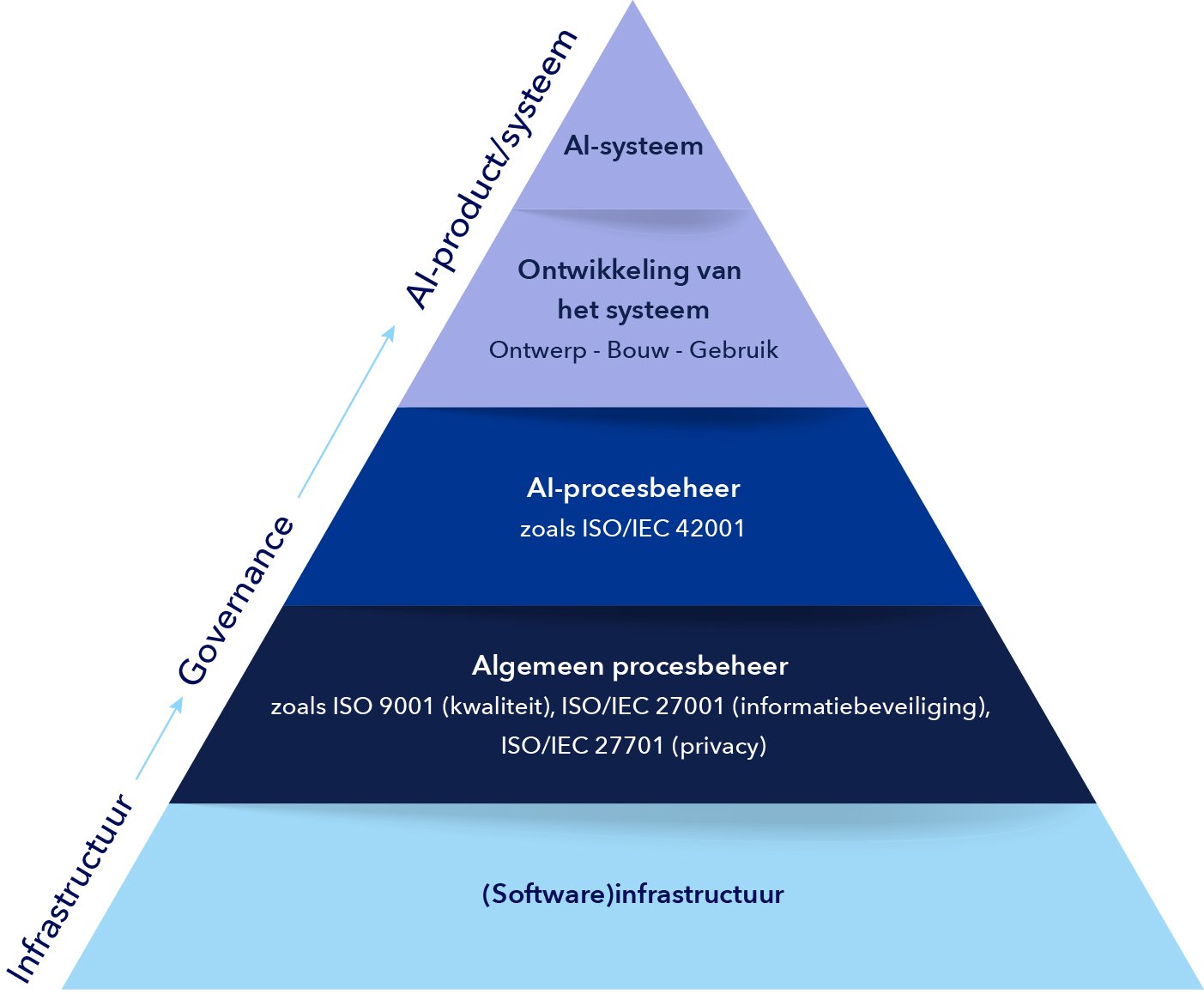

Normen en certificering van managementsystemen kunnen dienen als solide fundament voor de AI-governance van organisaties (zie figuur 1). De internationale norm ISO/IEC 42001 voor AI-managementsystemen biedt richtlijnen en vereisten voor organisaties die AI-systemen ontwikkelen, implementeren of toepassen.

Deze langverwachte norm werd eind 2023 gepubliceerd en is bedoeld voor gebruik in alle sectoren door organisaties van elk type en elke omvang die betrokken zijn bij het ontwikkelen, leveren of toepassen van producten en/of diensten die gebruikmaken van AI-systemen. Omdat het een ISO-norm betreft, is ISO/IEC 42001 compatibel met en complementair aan andere ISO-managementsysteemnormen, zoals ISO 9001 (kwaliteit) en ISO/IEC 27001 (informatiebeveiliging). ISO/IEC 42001 vindt een evenwicht tussen het bevorderen van AI-innovatie en het implementeren van effectieve governance.

Dit betekent dat u kunt putten uit (en voortbouwen op) bestaande managementsystemen en algemeen procesbeheer. De norm biedt een complete benadering om te bepalen hoe AI een integraal onderdeel kan worden gemaakt van producten, diensten of zelfs interne applicaties.

In het onderstaande schema is ISO/IEC 42001 gepositioneerd als een tool voor procesgovernance in de ‘pyramid of assurance’. Aan de basis van de piramide bevindt zich de elementaire infrastructuur van de organisatie. Deze bevat alles wat nodig is om de organisatie te laten functioneren. Om governance en voortdurende verbetering mogelijk te maken, kiezen veel organisaties voor het implementeren van managementsystemen die voldoen aan managementsysteemnormen voor kwaliteit (ISO 9001), informatiebeveiliging (ISO/IEC 27001) of andere aspecten. Certificering biedt vervolgens een middel om conformiteit aan te tonen tegenover verschillende stakeholders.

Aangezien ISO/IEC 42001 een vergelijkbare structuur heeft als de andere ISO-managementsysteemnormen, is het relatief eenvoudig om uw managementsysteem aan te vullen met vereisten voor een AI-managementsysteem. Op deze manier vormt uw procesgovernance de basis voor het ontwerpen, bouwen en gebruiken van betrouwbare AI-systemen.

‘Pyramid of assurance’. Managementsystemen spelen een fundamentele rol bij de governance van processen om risico’s te beheersen en veilige, betrouwbare en ethische AI-systemen te waarborgen.

De belangrijkste doelstellingen van ISO/IEC 42001 zijn:

- een raamwerk en methodologie bieden voor het opzetten, implementeren, onderhouden en verbeteren van een AI-managementsysteem dat de gehele AI-levenscyclus bestrijkt, op basis van een risicogerichte aanpak;

- aantonen en communiceren van de betrouwbaarheid van de AI-systemen en de bijbehorende processen van de organisatie;

- naleving bevorderen van regelgeving, wat steeds belangrijker zal worden met de toenemende nationale en internationale wetgeving, zoals de Europese AI-verordening die in 2025 wordt verwacht;

- samenwerking en integratie van AI-systemen en -processen vergemakkelijken;

- samenwerking en coördinatie tussen stakeholders bevorderen;

- innovatie en verbetering van AI-systemen en -processen ondersteunen;

- adoptie en verspreiding van best practices en normen op het gebied van AI-management aanmoedigen.

De relatie tussen ISO/IEC 42001 en de wet- en regelgeving rond AI zal naar verwachting synergie en wederzijds voordeel opleveren. Terwijl de Europese AI-verordening een duidelijke productfocus heeft, biedt het invoeren van een AI-managementsysteem een basis om consistente, voorspelbare en vertrouwde AI-systemen te bouwen en te leveren, aangezien de beheersmechanismen van de norm aansluiten bij de vereisten van de regelgeving.

Uiteindelijk zal een goed geïmplementeerd en op alle relevante normen afgestemd managementsysteem zowel de integriteit als de privacy en het ethisch gebruik van data waarborgen en tegelijkertijd voldoende aanpasbaar zijn om de technologische vooruitgang en de steeds veranderende vereisten van klanten, toezichthouders en andere partijen te integreren.

De beste route?

Om een begin te maken met het proces voor invoering van een managementsysteem dat is gecertificeerd volgens ISO/IEC 42001, kunt u de whitepaper van DNV ‘In 8 stappen op weg naar certificering’ en de bijbehorende self-assessment tool als leidraad gebruiken. Het proces begint met een analyse door het senior management om de belangrijkste doelstellingen voor de invoering van een AI-managementsysteem (AIMS) in kaart te brengen. Vervolgens kunnen organisaties de ISO/IEC 42001-norm aanschaffen en een strategische richting bepalen die aansluit bij de geïdentificeerde doelen.

De volgende stappen bestaan uit de planning en toewijzing van middelen, het begrijpen en in kaart brengen van de belangrijkste processen en het identificeren van trainingsbehoeften voor medewerkers. Het voorbereiden, ontwikkelen en implementeren van passende processen en procedures zijn ook veelvoorkomende stappen. Daarnaast is het belangrijk om onderweg interne audits en managementbeoordelingen uit te voeren om de effectiviteit van het systeem te bewaken. Het gebruik van de self-assessment tool van DNV helpt bij het identificeren van de tekortkomingen ten opzichte van de vereisten van de ISO/IEC 42001-norm en maakt een gerichte aanpak mogelijk om aan deze vereisten te voldoen.

Waarom DNV?

Als wereldwijd toonaangevende certificatie-instelling is DNV door 80.000 organisaties over de hele wereld gekozen om te voorzien in hun behoeften op het gebied van certificering en trainingen voor managementsystemen. We beschikken over unieke competenties, branchekennis en capaciteiten op het gebied van AI- en andere managementsystemen. Wanneer u DNV kiest, profiteert u van de onderstaande voordelen.

- Een wereldwijde certificatie-instelling in informatiebeveiliging en privacymanagement: We hebben een uitstekende staat van dienst op het gebied van informatiebeveiliging en privacymanagement certificering en -training. Dit zijn essentiële factoren om te integreren in uw AI-management.

- Risk Based Certification™: Wij hanteren een proactieve, risicogerichte benadering van certificering. Dit betekent dat we organisaties helpen om potentiële risico’s in hun AI-systemen vroegtijdig te identificeren om te zorgen dat ze effectief worden beheerst voordat ze een probleem gaan vormen.

- Lumina™: Lumina is onze data-smart benchmarkingtool voor diepgaande inzichten en analyses met betrekking tot managementsystemen, van de meest voorkomende fouten en oplossingen tot een volledig overzicht van bedrijfslocaties en vergelijkingen met concurrenten.

- Trainingsbeheer: digitale oplossingen om uw organisatie te helpen bij het beheren en waarborgen van consistente bewustwording en competentieontwikkeling van medewerkers in de hele organisatie.

- Competente auditors die een pragmatische aanpak hanteren, luisteren naar de wensen en behoeften van de klant en zorgen dat de naleving van de norm wordt gecontroleerd.

DNV levert betrouwbare en waardetoevoegende diensten op het gebied van AI-assurance. Op basis van onze onafhankelijkheid, onze rol als externe partij en het uitgangspunt dat we geen concessies doen ten aanzien van kwaliteit en integriteit, werken we als partners samen met klanten om hen te helpen bij het omgaan met de complexiteit van AI en de bijbehorende uitdagingen, en om te zorgen voor de governance die nodig is om veilige, betrouwbare en robuuste AI-systemen te leveren.

![ISO/IEC 42001 Artificial Intelligence Management System AIMS Requirements Course [Engelstalig]](/siteassets/images/ai_1288x511pxl.jpg?mode=crop&scale=both&quality=90&format=webp&width=820&height=471)